چرا هوش مصنوعی خطرناک است؟

چرا هوش مصنوعی خطرناک است؟

هوش مصنوعی به عنوان یکی از پیشرفتهای چشمگیر فناوری و تکنولوژی توانسته در بسیاری از حوزهها تغییرات بزرگی را به همراه داشته باشد. اما در کنار مزایا و قابلیتهای آن، همواره باید به جنبههای منفی و خطرات مرتبط با هوش مصنوعی نیز توجه کرد. در این پست به بررسی خطرات هوش مصنوعی می پردازیم. از تأثیرات آن بر روی مشاغل و اشتغال گرفته تا نگرانیهای مربوط به انتشار خبرهای جعلی، سوگیریها و امنیت و حریم خصوصی. درک و توجه به این خطرات به سازگاری و استفاده مسئولانه از هوش مصنوعی در زمینههای مختلف کمک خواهد کرد.

چرا ما از هوش مصنوعی می ترسیم؟

ظهور هوش مصنوعی منجر به احساس عدم اطمینان و ترس نسبت به فناوری شده است که اکثر مردم آن را به طور کامل درک نمی کنند. هوش مصنوعی میتواند کارهایی را انجام دهد که قبلاً فقط انسانها میتوانستند آن ها را انجام دهند. هوش مصنوعی اکنون میتواند از آثار هنری و مقالات گرفته تا گزارشهای علمی و غیره را دقیقا مشابه و حتی بهتر از انسان تولید کند. با این حال، کارشناسان نگران هستند که سیستم های هوش مصنوعی ممکن است اطلاعات نادرست، تهدیدات امنیت سایبری، از دست دادن شغل و سوگیری سیاسی ایجاد کند.

به عنوان مثال، سیستم های هوش مصنوعی می توانند ایده های پیچیده را به طور منسجم و سریع به دلیل مجموعه داده ها و اطلاعات عظیمی که دارند بیان کنند. با این حال، اطلاعاتی که توسط هوش مصنوعی برای تولید پاسخ ها استفاده می شود، به دلیل ناتوانی هوش مصنوعی در تشخیص داده های معتبر، نادرست است. بنابراین استفاده از سیستم های هوش مصنوعی ممکن است این اطلاعات نادرست را در نوشته ها، متون و مقالات دانشگاهی ترویج کند.

علاوه بر این، الگوریتمهایی که قابلیتهای عملیاتی هوش مصنوعی را تشکیل میدهند توسط انسانهایی با سوگیریهای سیاسی و اجتماعی ساخته میشوند. اگر بشریت برای جستجوی اطلاعات به هوش مصنوعی متکی شود، این سیستمها میتوانند تحقیقات را به گونهای سازماندهی کنند که به نفع یک طرف سیاسی باشد.

آیا هوش مصنوعی خطرناک است؟

هوش مصنوعی مزایای زیادی برای انسان دارد، از جمله ساده کردن کارهای پیچیده و روزمره و می تواند به عنوان یک دستیار، هفت روز هفته و 24 ساعته در خدمت شما باشد. با این حال، هوش مصنوعی این پتانسیل را دارد که از کنترل خارج شود. در ادامه به خطرات هوش مصنوعی می پردازیم.

خطر برای مشاغل

اتوماسیون شغلی مبتنی بر هوش مصنوعی (انجام عملیاتهای ترتیبی از پیش تعیین شده توسط هوش مصنوعی و بدون دخالت انسان) یک نگرانی مبرم است زیرا این فناوری در صنایعی مانند بازاریابی، تولید و مراقبت های بهداشتی پذیرفته شده است. انتظار میرود بین سالهای 2020 تا 2025، هشتاد و پنج میلیون شغل به دلیل اتوماسیون از بین برود.

همانطور که رباتهای هوش مصنوعی باهوشتر و ماهرتر میشوند، همان وظایف به انسانهای کمتری نیاز خواهند داشت. درست است که هوش مصنوعی تا سال 2025 حدود 97 میلیون شغل جدید ایجاد خواهد کرد، اما بسیاری از کارمندان مهارت های مورد نیاز برای این نقش های فنی را نخواهند داشت و اگر شرکت ها و کشورها نیروی کار خود را ارتقاء ندهند، ممکن است عقب بمانند. حتی مشاغلی که به مدارک تحصیلات تکمیلی و آموزش های پس از دانشگاه نیاز دارند، از قدرت هوش مصنوعی مصون نیستند.

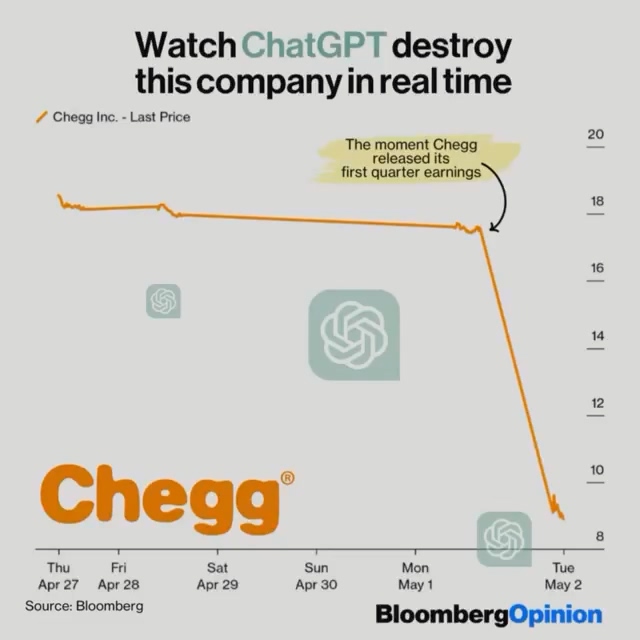

در نمودار زیر کاهش ارزش سهام شرکت بزرگ آمریکایی Chegg را مشاهده می کنید. این شرکت خدمات تدریس خصوصی، نوشتن دیپلم و غیره را ارائه می دهد که توجه به اینکه کاربران از ChatGPT برای این هدف استفاده می کنند این شرکت را متحمل خسارت جدی کرده است.

خطر انتشار محتوای جعلی و نادرست

هوش مصنوعی تاثیر قابل توجهی در انتشار خبرهای جعلی دارد. این محتواهای جعلی میتوانند شامل مقالات، گزارشها و حتی ویدئوهایی با قابلیت اقناع بالا باشند که خطر جدی را برای جامعه به وجود میآورد، زیرا ممکن است باعث گمراهی افراد، افزایش اختلافات اجتماعی و تضعیف اعتماد عمومی شود. همچنین، این خبرهای جعلی میتوانند تأثیر منفی بر رسانهها و سیاستها داشته باشند و فرآیندهای تصمیمگیری را به خطر بیاندازند.

با توجه به قابلیتهای هوش مصنوعی، تشخیص خبرهای جعلی نیز مشکل تر شده است. هوش مصنوعی اکنون می تواند محصولاتی با کیفیت انسانی از جمله مقالات، متون و ویدیوهای جعلی و گمراه کننده را ایجاد کند. اطلاعات جعلی و نادرست مشکل جدیدی نیست، اما هوش مصنوعی به آن اجازه می دهد تا در سطوحی که قبلاً دیده نشده بود، به طرز بیسابقهای تولید شوند. این بدین معناست که حجم بالایی از اطلاعات جعلی به سرعت و با دقت بالا منتشر میشوند که تشخیص آنها بسیار دشوار است. این مسئله نه تنها بر روی مخاطبان اثرگذار است، بلکه میتواند بر رسانهها و مؤسسات خبری نیز تأثیر منفی بگذارد، زیرا اعتبار رسانهها به خطر میافتد و فرآیندهای خبرنگاری و ارزیابی خبرها تحت تأثیر قرار میگیرند.

خطر ایجاد تعصب، تبعیض و جانبداری

از آنجا که سیستمهای هوش مصنوعی از اطلاعات و دادههای موجود یاد میگیرند و در این داده ها نیز ردپایی از تعصبات و تبعیض موجود است بنابراین اگر دادههای مورد استفاده بیش از حد تعصبی یا ناعادلانه باشند، سیستم هوش مصنوعی نیز این تعصبات را تقویت کند و در تولید محتواها و تصمیمگیریهای خود تمایل به تبعیض پیدا می کند. این موضوع میتواند منجر به بروز نابرابریهای اجتماعی، تبعیض و تعصب شود.

علاوه بر این، هوش مصنوعی ممکن است به سوگیری در فرآیند تصمیمگیری نیز منجر شود. زیرا سیستمهای هوش مصنوعی معمولاً بر اساس الگوریتمها و قوانین مشخص عمل میکنند که ممکن است نتایجی را تولید کنند که به طور ناعادلانه و سوگیرانه به برخی افراد یا گروهها اختصاص داده شوند. این موضوع میتواند نتایج ناعادلانه ای در فرآیندهای تصمیمگیری ایجاد کند.

به خطر افتادن امنیت و حریم خصوصی

استفاده گسترده از هوش مصنوعی میتواند باعث به خطر افتادن امنیت و حریم خصوصی فردی و سازمانی شود. با توانایی هوش مصنوعی در جمعآوری، تجزیه و تحلیل و استفاده از حجم عظیمی از دادهها، احتمال نفوذ به سیستمها و دستیابی به اطلاعات حساس افزایش مییابد. برخی از تهدیدات امنیتی شامل نفوذ به شبکهها، جاسوسی، دسترسی غیرمجاز به اطلاعات شخصی و سرقت اطلاعات است که میتواند منجر به آسیب دیدن فردی و سازمانی و نقض حریم خصوصی شود.

خطر انتشار بدافزار و ویروس

هوش مصنوعی میتواند در انتشار بدافزارها نقش مهمی داشته باشد. با استفاده از تواناییهای هوش مصنوعی، بدافزارها میتوانند به صورت خودکار و به طور مداوم ایجاد شوند. علاوه بر این، هوش مصنوعی میتواند بدافزارها را بهبود می بخشد و روشهای جدیدی برای مهندسی و گسترش آنها ارائه دهد. این امر منجر به افزایش تعداد و پیچیدگی بدافزارهای مخرب میشود که میتواند به شبکهها و سیستمهای مختلف آسیب برساند.

تأثیر انتشار بدافزارهای تولید شده توسط هوش مصنوعی بر روی امنیت افراد و سازمانها نمیتواند نادیده گرفته شود. بدافزارهایی که با استفاده از هوش مصنوعی تولید میشوند، میتوانند روشهای پیشرفتهتری برای نفوذ، جاسوسی، سرقت اطلاعات و تخریب سیستمها به کار بگیرند. این بدافزارها میتوانند با استفاده از الگوریتمهای هوشمند، تشخیص و اجتناب از سیستمهای امنیتی را دشوار کنند و بدون تشخیص اقدامات خود را انجام دهند. در نتیجه، حملات سایبری با استفاده از بدافزارهای تولید شده توسط هوش مصنوعی میتوانند نقض امنیت شخصی و سازمانی را به همراه داشته باشند.

خطر ماشینهای هوشمند و خود مختار

بسیاری از محققان نگرانند که سیستمهای هوش مصنوعی به سطحی ارتقا پیدا کنند که اراده خودشان را توسعه دهند و اقداماتی را انجام دهند که با منافع انسان در تضاد باشد یا حتی موجودیت انسان را تهدید کند. این یک خطر واقعی بلند مدت است. اما با این حال، بر این باوریم که سیستمهای هوش مصنوعی کنونی نمی توانند بدون پیشرفتهای ساختاری اساسی در این فناوری، خود مختار شوند. بنابراین، در حالی که این یک خطر واقعی برای صنعت است که باید روی آن تمرکز کند، اما این فوری ترین خطری نیست که پیش روی خود می بینیم.

سخن پایانی

هوش مصنوعی با وجود مزایا و امکانات قابل توجهی که به جامعه و صنایع ارائه میدهد، با خطراتی نیز همراه است. تأثیرات منفی هوش مصنوعی بر مشاغل، به ویژه در برخی حوزههایی که به قابلیتهای انسانی نیازمند هستند، نمیتواند نادیده گرفته شود. از سوی دیگر، هوش مصنوعی در انتشار خبرهای جعلی، جانبداری، مشکلات اخلاقی و حقوقی، امنیت و حریم خصوصی، و انتشار بدافزارها تأثیر قابل توجهی دارد.

اما به همراه این خطرات، هوش مصنوعی نیز با مزایا و فرصتهای بزرگی همراه است. این فناوری میتواند به بهبود عملکرد و کارایی در حوزههای مختلف کمک کند، به خلاقیت و نوآوری دست یابد و به ساخت و تولید بهتر و سریعتر کمک کند. هوش مصنوعی میتواند در تحقق تغییرات اجتماعی و اقتصادی، بهبود سطح زندگی و رفاه افراد و حل مشکلات جامعه نقش موثری ایفا کند.

توسعه سیاستها، قوانین و مقررات مربوط به هوش مصنوعی، آموزش و آگاهی جامعه در این زمینه و همکاری بین صنعت و نهادهای مربوطه میتواند به سازگاری و بهرهبرداری موفق از این فناوری منجر شود.